Deze blog verscheen in een andere vorm op onze blog 3-Star Learning Experiences waar Mirjam eerste auteur van het stuk was.

Een goed artikel van Bibeg Limbu, Halszka Jarodzka, Roland Klemke en Marcus Specht (2018; echt een aanrader!) inspireerde ons om deze blog te schrijven. Het artikel geeft een overzicht van 78 studies over augmented reality[1] (AR), waarbij gebruik wordt gemaakt van sensoren om ‘apprentices’ (leerlingen in een bepaald vak) te trainen, onder andere via het vastleggen van wat een expert doet. We vroegen ons af wanneer het nou eigenlijk zinvol is om dit soort AR in te zetten voor leren.

Laten we eerst eens kijken wat ‘apprenticeship’ precies is en welke rol het vastleggen van expert performance spelt bij het leerproces.

Het ‘Apprenticeship’ Model

Apprenticeship is niet makkelijk te vertalen naar het Nederlands. Soms wordt het vertaald als ‘leerling’ of ‘beginner’, maar die begrippen zijn natuurlijk nogal breed. Eigenlijk is het zoiets als het vroegere ‘gezel’, want de term vindt zijn oorsprong in` het gildesysteem in de middeleeuwen (dus gezel-schap). Gilden waren verenigingen waarin koop- of ambachtslieden de belangen van hun eigen beroepsgroep behartigden. Een soort beroepsvereniging dus. In het gildesysteem was een gezel diegene die onder de supervisie van de ‘meester’ viel, ofwel van de expert. Deze gezellen waren relatief goedkope krachten en ter compensatie voor het lage salaris kregen ze da kost en inwoning en, niet onbelangrijk in deze context, formele training in het betreffende vak of beroep. In de modern tijd zouden we een apprentice wellicht stagiair noemen of in specifieke beroepen LiO (Leraar in Opleiding) of AGiO (Assistent Geneeskunde in Opleiding). In deze blog gebruiken we gewoon apprentice en vertalen we het dus niet.

Iets recenter, in 1989, legden Alan Collins, John Seely Brown en Susan Newman – allen werkzaam bij Xerox Palo Alto Research Center – Jean Lave’s werk uit. Lave richtte zich op apprenticeship en in de context van haar werk verwijst het naar specifieke ondersteunende methoden om de apprentice te helpen om taken te kunnen uitvoeren (haar onderzoek werd uitgevoerd in een kleermakerscontext). De apprentice leert deze methodes door de expert te observeren. Verder coacht de expert de apprentice en oefent de apprentice onder het toeziend oog van de expert (een voorbeeld van een methode is modelleren). In een dergelijke situatie (denk bijvoorbeeld ook aan een stagiaire in een ziekenhuis of een duale student in een garage) gaat het om de interactie tussen het observeren, ondersteuning krijgen en langzaam maar zeker onafhankelijker kunnen oefenen. Dit samenspel is belangrijk voor apprentices hun eigen vaardigheden te leren inschatten en ze te corrigeren.

Natuurlijk zijn er ook leertaken die je niet gemakkelijk kunt observeren, bijvoorbeeld als het gaat om het oplossen van complexe problemen. In dat geval ligt de focus op cognitieve en metacognitieve processen en vaardigheden. Omdat deze niet zomaar ‘geobserveerd’ kunnen worden, moeten ze op een of andere manier zichtbaar gemaakt worden. Voor dit soort taken hebben Collins en collega’s de term ‘cognitive apprenticeship’ geïntroduceerd.

Op het moment dat we instructie willen ontwerpen dat gebaseerd is op een dergelijk model, dan moeten we dus op een of andere manier het gedrag[2] – zowel mentaal als fysiek – van de expert vast zien te leggen zodat we kunnen begrijpen hoe ‘goed’ er uit ziet. Maar hoe?

Hoe kunnen we expertgedrag vastleggen?

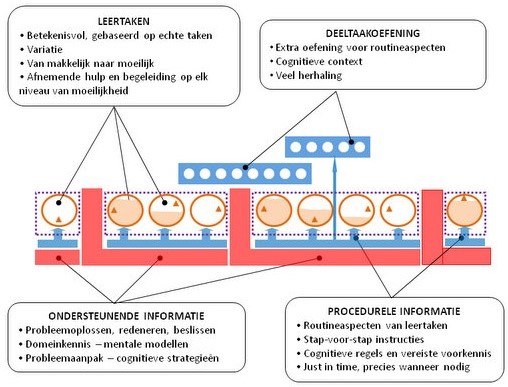

Er zijn procedures, zoals cognitieve taakanalyse (CTA), die je kunt gebruiken om inzicht te krijgen in de mentale processen van een expert. Met CTA kunnen we dan betekenis geven aan waarneembaar gedrag en vervolgens kunnen we dat gedrag organiseren (Van Merriënboer & Kirschner, 2018). Bijvoorbeeld, in het 4C/ID model, vormen stappen 2 en 3 (designing performance assessment en sequence learning tasks; ontwerpen van de wijze van toetsing en de opeenvolging van de leertaken), 5 en 6 (analyse cognitive strategies en analyse mental models; cognitieve strategieën en mentale modellen), en 8 en 9 (analyse cognitive rules en analyse prerequisite knowledge; analyseren van de cognitieve regels en analyseren van de vereiste voorkennis) tezamen een geïntegreerd CTA systeem (zie afbeelding).

Echter, CTA heeft twee grote beperkingen. Ten eerste kost het heel veel tijd en ten tweede kun je niet zomaar het gedrag van de expert bij het uitvoeren van een taak kopiëren, simpelweg omdat er altijd overwegingen, stappen en details zijn die aan ons waarnemende oog onttrokken blijven. Dat komt omdat je bij CTA afhankelijk bent van wat experts je vertellen wat zij doen. Dit brengt ons bij twee andere bekende problemen bij het vastleggen van expertgedrag bij het uitvoeren van een taak. Het eerste probleem is dat experts vaak de complexiteit van een taak onderschatten. Dat komt simpelweg omdat het voor hen nu eenmaal niet moeilijk is! Ze hoeven er vaak niet eens bij na te denken. Ook hebben experts vaak geen idee van de enorme hoeveelheid kennis die ten grondslag ligt aan hun gedrag (deze kennis heeft zich namelijk verenigt en ingekapseld in grotere ‘stukken’ kennis en vaardigheden of ‘opgestapeld’ door de jaren heen). Dit alles leidt tot het derde probleem bij het vastleggen van expert performance namelijk dat experts vaak stappen ‘overslaan’ zonder dat ze zich daar bewust van zijn (die stappen zijn geautomatiseerd en/of gecombineerd). Deze stappen gaan automatisch en zijn daarom voor experts vanzelfsprekend. In het Duits noemen we dit Fingerspitzengefül; in het Nederlands zouden we kunnen zeggen dat die kennis impliciet is / zij voelen het aan hun water. Dit is problematisch voor diegenen die een taak nog moeten leren omdat zij inzicht nodig hebben in alle stappen. Zij moeten immers nog leren om patronen te herkennen die hen op den duur in staat zal stellen om ook zelf stappen over te kunnen slaan. Met andere woorden, experts vinden het vaak moeilijk om hun kennis expliciet te maken op een precieze manier (zie ook twee van onze eerdere (Engelstalige) blogs over expertise, hier en hier). Sensoren kunnen gelukkig een handje helpen.

Gebaseerd op werk van Chi e.a. 1982; DeGroot; 1965; Kalyuga, Chandler & Sweller, 1998; Schneider & Shiffrin, 1997; Wilson & Cole, 1996

Welke rol kunnen sensoren spelen bij het vastleggen van expertgedrag?

Sensoren kunnen CTA ondersteunen door ons de mogelijkheid te bieden om op een niet ingrijpende (non-invasive) wijze moeilijk of niet-waarneembare dingen toch te meten (Limbu et al., 2018). Hoewel er nog niet veel onderzoeken zijn die specifiek kijken naar het vastleggen van de cognitieve processen van experts door middel van sensoren, is dat nu juist wel de potentiële kracht van sensoren.

Trots kan Paul melden dat een van de pioniers op dit gebied zijn oude collega Hans Stolk is, die aan de Open Universiteit zelf een oogbewegingsapparaat (de Blikvanger) ontwikkelde gedurende zijn promotieonderzoek en die gebruikte om het lees- en leerproces van studenten zichtbaar te maken.

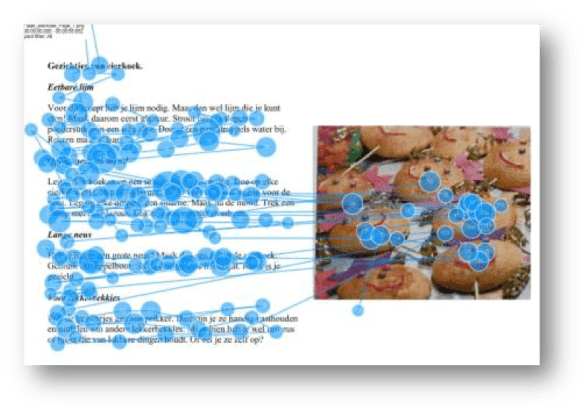

Bijvoorbeeld, Jarodzka e.a., (2013) maken gebruik van oogbewegingsdata gedurende taakanalyse om de cognitieve processen van experts expliciet te maken. Nadat hun oogbewegingen en de patronen ervan zijn vastgelegd, worden experts geconfronteerd met de meest opvallende oogbewegingen en patronen. Vervolgens worden de experts gevraagd om uit te leggen waar ze naar keken en waarom. Dit wordt ‘cued retrospective reporting’ (aangespoord achteraf rapporteren) genoemd. Met andere woorden, de sensoren kunnen helpen om het onzichtbare zichtbaar te maken (op redelijk objectieve wijze!).

Hieronder vind je een voorbeeld van hoe een ervaren docent naar een klas kijkt. Hoe groter de cirkels, hoe langer er naar gekeken is; de lijnen ertussen zijn de sprongen in het blik. Op basis hiervan plus de video van haar/zijn oogbewegingen worden saillante oogbewegingen en –fixaties besproken met de docent (bijv., Waarom heb je heel lang naar X gekeken? Je sprong steeds heen en terug tussen Y en Z: Waarom? enzovoorts).

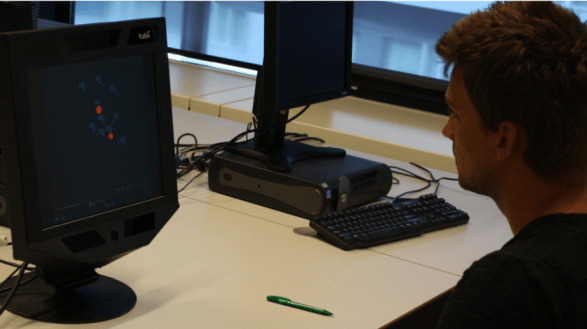

En hier de opstelling voor het registreren van hoe een leerling luchtverkeersleider kijkt naar een beeldscherm met vliegtuigen uit het onderzoek van Ludo van Meeuwen:

En tot slot hoe er een tekst met beeld bestudeerd wordt:

Het vastleggen van gedrag is één ding, maar hoe zit het met de daadwerkelijke training? Waarom zou je een op sensoren gebaseerd AR ontwerp gebruiken om mensen te trainen? Laten we eerst eens naar wat algemene voorbeelden kijken en daarna naar wat specifiekere toepassingen.

Voorbeelden van het gebruiken van sensoren bij het trainen van mensen

Zoals gezegd eerst wat algemene voorbeelden hoe op sensors gebaseerde AR gebruikt kan worden voor trainingsdoelen:

- Door onzichtbare aspecten van de uitvoering van een taak zichtbaar te maken, kan de apprentice het proces beter begrijpen.

- Door onzichtbare aspecten van de uitvoering van een taak zichtbaar te maken, kan de leerontwerper een betere leersituatie ontwerpen.

- Als data van expertgedrag zijn vastgelegd, kan het gebruikt worden om experts te helpen expliciet te maken wat ze gedaan hebben en waarom. Het gaat dan voornamelijk om de stappen te identificeren die ze tijdens de traditionele CTA hebben overgeslagen.

- De vastgelegde gedragsdata kan gebruikt worden om experts en/of leerontwerpers te helpen om training materialen te creëren in een taakdemonstratie.

- Apprentices kunnen de demonstratie van de expert (inclusief de sensor data) opnieuw bekijken terwijl ze zelf de taak tegelijktijdig uitvoeren.

- De expertgedragsdata kan gebruikt worden om formatieve feedback te geven door het expertgedrag als ‘gouden standaard’ te gebruiken.

- Sensorsystemen kunnen apprenticegedrag lezen en opslaan. De expert kan op die manier de voortgang van de apprentice bijhouden.

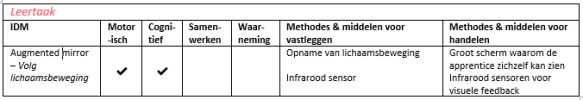

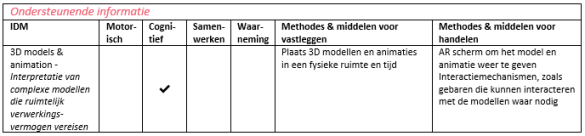

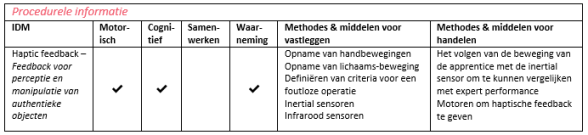

Op naar de specifieke voorbeelden! In de afbeelding zijn verschillende instructiemethodes (de auteurs noemen ze ‘Instructional Design Methods; IDMs) georganiseerd in lijn met de vier componenten van het 4C/ID model.

4C/ID Model (Van Merriënboer & Kirschner, 2018)

Limbu en zijn collega’s hebben gekeken welke vaardigheden je met een IDM kunt trainen. Ze geven ook voorbeelden van de type sensoren die je voor elke methode zou kunnen gebruiken. We bespreken één voorbeeld voor elk component van het 4C/ID model. We hebben gekozen om de IDMs niet te vertalen naar het Nederlands, omdat dat waarschijnlijk alleen maar verwarring zou scheppen.

Deze YouTube video laat een interessant voorbeeld zien van een ‘augmented mirror application’ tijdens sportcoaching. De sensoren registreren de bewegingen van het meisje en tonen deze op de spiegel. Hierdoor kan zij haar eigen bewegingen expliciet via de spiegel volgen en ze zo makkelijker corrigeren.

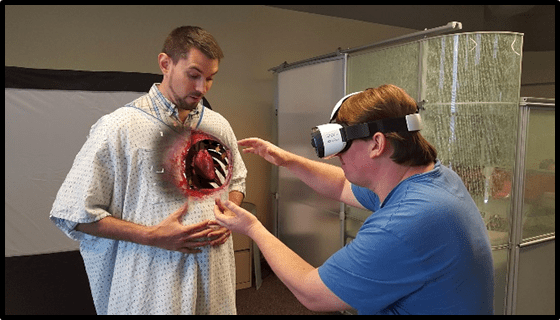

Hier zie je een voorbeeld van 3D ‘augmented reality’ operatiekleding. Het hemd heeft toegang tot de medische geschiedenis van de patiënt (bv MRIs, röntgenfoto’s). Alle informatie kan bekeken worden via de AR-headset die die dokter draagt en het betreffende gebied kan weergegeven worden op het lichaam van de patiënt.

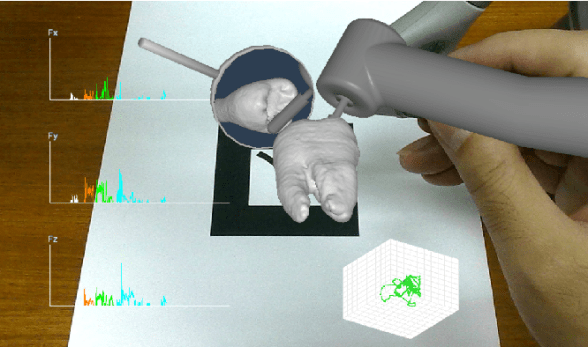

Het volgende voorbeeld is haptische feedback – terugkopping die gevoelsmatig en tastbaar is – bij tandheelkunde (het volledige onderzoek kun je hier lezen). Studenten kunnen oefenen in de AR omgeving. Je ziet een virtuele tand en een virtuele spiegel. Het resultaat van de handelingen die de student uitvoert, kan de student volgen via een video die getoond word op een doorzichtig scherm dat de student op het hoofd draagt. De student ontvangt ook haptische feedback via een soort sonde die wordt gebruikt om de tand te onderzoeken, zodat de student bijvoorbeeld kan voelen hoe hard de tand is. De student kan ook boren of snijden. Er is nog een haptisch instrument om de virtuele spiegel te sturen.

Nu blijven we nog met de vraag zitten wanneer dit soort AR toepassingen nou een goede keus zijn.

Wanneer werkt AR met sensoren?

Carmichael, Biddle, en Mould (2011) onderzochten precies die vraag. Het mag geen verrassing zijn dat het antwoord is: Het hangt ervan af. Algemeen gesproken heeft AR vier voordelen:

- Gratis realiteit – ‘Augmented’ ervaringen kunnen rijker, eleganter, of subtieler zijn omdat je bewust keuzes kunt maken welke objecten en gedragingen onderdeel van de omgeving moeten zijn en waarom.

- Virtuele flexibiliteit – De verschijningsvorm en het gedrag van wat je naar kijkt (men spreekt van een digitale artefact) kan aangepast worden aan wat de gebruiker nodig heeft. Ook kan de gebruiker dingen oefenen die anders onmogelijk, onpraktisch, of te gevaarlijk zouden zijn (denk bijvoorbeeld aan het onderhoud van mobiele telefoonpalen).

- Onzichtbare interface – De interface botst niet met de mogelijkheid om in een levensechte omgeving iets te observeren en de gebruiker kan naadloos met zijn aandacht tussen echte en virtuële objecten switchen.

- Ruimtelijke besef – De inhoud kan zich aanpassen aan de veranderende omgeving van de gebruiker.

Carmichael c.s. laten zien dat de overwegingen die je maakt voor een leerontwerp afhangen van de cognitieve theorie die je toepast op het leerdoel. Ze onderzochten de relatie tussen vier theorieën en hun ontwerpvoordelen voor AR. De theorieën zijn:

- Mentale modellen – Representaties van de wereld die mensen hebben geleerd / verworven, worden gebruikt om te redeneren over een bepaald inhoudsdomein.

- Gedistribueerde cognitie (ENG: Distributed cognition) – Deze theorie gaat uit van een systeem en niet van een individu. Het gaat vooral om de connectie tussen alle belangrijke kenmerken die bijdragen aan het succesvol volbrengen van een taak door alle deelnemers aan die taak. Voorbeelden zijn de omgeving, een netwerk van mensen die bij de taak betrokken zijn en wat ze aan het doen zijn (de artefacten).

- Gesitueerde cognitie (ENG: Situated cognition) – Deze theorie komt van Brown, Collins en Duguid (1989). Uitgangspunt is dat kennis onscheidbaar is van ‘doen’ en dat alle kennis is gesitueerd in context-specifieke (sociale, culturele, fysieke) activiteiten.

- Belichaamde cognitie (ENG: Embodied cognition) – Deze theorie stelt dat onze motorische systemen onze cognitieve systemen beïnvloeden en andersom. Dit houdt in dat het lichaam interactiemodellen met de wereld kan maken of ondersteunen. Een individu kan lichamelijke actie ondernemen en herhaaldelijk ‘verhaal halen’ bij de omgeving om betekenis te geven aan de wereld.

Binnen een apprenticemodel spelen alle vier de theorieën een rol, afhankelijk van de leertaak. De overwegingen met betrekking tot het leerontwerp variëren, afhankelijk van de theorie die wordt toegepast.

Carmichael c.s. hebben ook een lijst gemaakt met algemene vragen, zodat je voor jezelf kunt nagaan of AR (waarbij gebruik wordt gemaakt van sensoren) een goed idee is in jouw specifieke ontwerpcontext of niet. Zo kun je geïnformeerd beginnen met beslissingen nemen…

- Is er sprake van een authentieke levensechte omgeving waarin de toepassing van de betreffende taak zich afspeelt?

- Is er een sterke, niet willekeurige verband tussen de virtuele data en de objecten die de toepassing gebruikt, evenals tussen de virtuele data en aspecten van de omgeving zelf?

- Is het belangrijk dat details van de omgeving, van inhoud tot gedrag, behouden worden?

- Als de toepassing het leren van een bepaalde taak ondersteunt, is deze taak een concrete taak die al in de echte wereld wordt uitgevoerd?

- Heeft de toepassing baat bij de levensechte context?

Wat nu?

Limbu en Carmichael laten zien dat er vele overwegingen moeten worden gemaakt als het gaat om het implementeren van sensor-gedreven AR oplossingen voor leren. Wij raden de lezer aan om met de checklist van Carmichael en collega’s te beginnen om eerst na te gaan of AR überhaupt voordelen heeft in de context van een leerdoel. Vervolgens, als het antwoord ‘ja’, ‘waarschijnlijk’, of ‘misschien’ is, dan kun je gaan nadenken over welke theorieën toepasbaar zijn op het leerdoel. Aan de hand daarvan bepaal je dan of en hoe de voordelen van AR dat specifieke doel kunnen ondersteunen. Als je klaar bent om in de details te duiken, kun je Limbu’s model gebruiken om beslissingen te nemen over welke sensoren de beste keuze zijn voor wat. Vanzelfsprekend zijn er, zoals altijd bij het ontwerpen van een leeroplossing, nog vele andere overwegingen te maken. We wensen je veel succes!

Onze advies? SOAR boven de rest met Sensoren Ondersteund Augmented Reality!

Bronnen

Brown, J. S., Collins, A., & Duguid, P. (1989). Situated cognition and the culture of learning. Educational Researcher, 18(1), 32-42. Verkrijgbaar via http://www.dtic.mil/dtic/tr/fulltext/u2/a204690.pdf

Carmichael, G., Biddle, R., & Mould, D. (2012, October). Understanding the power of augmented reality for Learning. In E-Learn: World Conference on E-Learning in Corporate, Government, Healthcare, and Higher Education (pp. 1761-1771). Association for the Advancement of Computing in Education (AACE). Verkrijgbaar via http://gigl.scs.carleton.ca/sites/default/files/gail_carmichael/elearn2012.pdf

Collins, A., Brown, J. S., & Newman, S. E. (1989). Cognitive apprenticeship: Teaching the crafts of reading, writing, and mathematics. In L. B. Resnick (Ed.), Knowing, learning, and instruction: Essays in honor of Robert Glaser (pp. 453-494). Hillsdale, NJ, US: Lawrence Erlbaum Associates, Inc. Verkrijgbaar via https://www.ideals.illinois.edu/bitstream/handle/2142/17958/ctrstreadtechrepv01987i00403_opt.pdf?sequence

Lave, J. (1988). Cognition in practice: Mind, mathematics, and culture in everyday life. Cambridge, UK: Cambridge University Press.

Limbu, B. H., Jarodzka, H., Klemke, R., & Specht, M. (2018). Using sensors and augmented reality to train apprentices using recorded expert performance: A systematic literature review. Educational Research Review, 25, 1-22. Verkrijgbaar via https://www.sciencedirect.com/science/article/pii/S1747938X18302811

Van Merriënboer, J. J., Clark, R. E., & De Croock, M. B. (2002). Blueprints for complex learning: The 4C/ID-model. Educational Technology Research and Development, 50(2), 39-61. Verkrijgbaar via https://www.researchgate.net/profile/Jeroen_J_G_Van_Merrienboer2/publication/225798787_Blueprints_for_complex_learning_The_4CID-model/links/0912f5100d35ede27a000000.pdf

Van Merriënboer, J. J., & Kirschner, P. A. (2018). Ten steps to complex learning: A systematic approach to four-component instructional design (3rd edition). New York, NY: Routledge.

[1] Augmented betekent eigenlijk vergroot of toegenomen; hier betekent het echter ‘toegevoegd’ of ‘verrijkt’. Hier gaat het echter om het toevoegen van iets aan de realiteit. Volgens Wikipedia is augmented reality (zij noemen het toegevoegde realiteit) een live, direct of indirect, beeld van de werkelijkheid waaraan elementen worden toegevoegd door een computer. Een AR-systeem voldoet, in het algemeen, aan drie voorwaarden, namelijk het is een systeem dat reëel en virtueel combineert, realtime interactief is en in drie dimensies functioneert.

[2] Wij gebruiken het woord gedrag hier, waar je in het Engels performance zou gebruiken om verwarring te voorkomen. Performance kan namelijk het proces betekenen (dus het gedrag / de uitvoering van een taak) maar ook het product (dus de prestatie).

9 november 2018

9 november 2018

Nog geen reacties ... Wees de eerste die een reactie plaatst!